El coeficiente de determinación (R²) mide qué tan bien un modelo estadístico predice un resultado. El resultado está representado por la variable dependiente del modelo.

El valor más bajo posible de R² es 0 y el valor más alto posible es 1. En pocas palabras, cuanto mejor sea un modelo para hacer predicciones, más cerca será su r² a 1.

- Si el R2 es 0, el modelo de regresión lineal no le permite predecir los puntajes del examen mejor que simplemente estimar que todos tienen una puntuación promedio de examen.

- Si el R2 está entre 0 y 1, el modelo le permite predecir parcialmente los puntajes del examen. Las estimaciones del modelo no son perfectas, pero son mejores que simplemente usar el puntaje de examen promedio.

- Si el R2 es 1, el modelo le permite predecir perfectamente la puntuación del examen de cualquier persona.

Más técnicamente, R2 es una medida de bondad de ajuste. Es la proporción de varianza en la variable dependiente que explica el modelo.

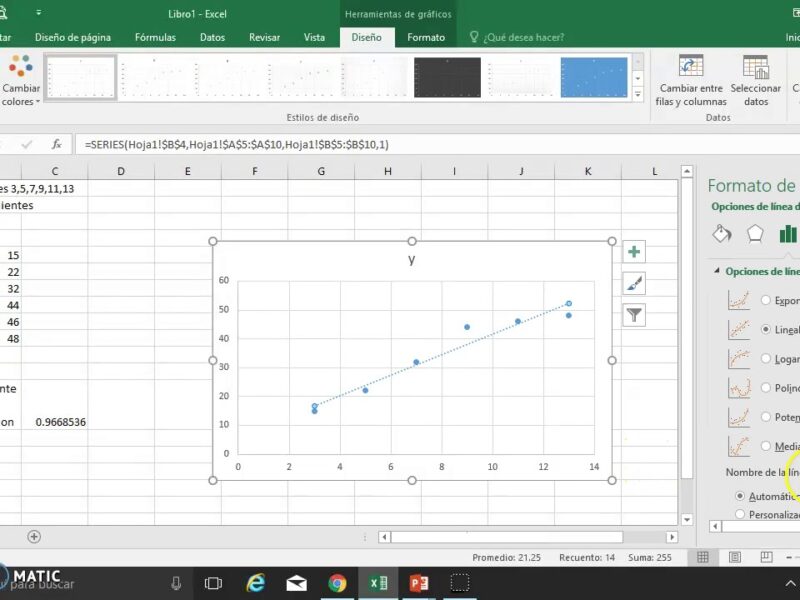

Graficar sus datos de regresión lineal generalmente le da una buena pista sobre si su R2 es alto o bajo. Por ejemplo, los gráficos a continuación muestran dos conjuntos de datos simulados:

- Si el R2 es 0, el modelo de regresión lineal no le permite predecir los puntajes del examen mejor que simplemente estimar que todos tienen una puntuación promedio de examen.

- Si el R2 está entre 0 y 1, el modelo le permite predecir parcialmente los puntajes del examen. Las estimaciones del modelo no son perfectas, pero son mejores que simplemente usar el puntaje de examen promedio.

- Si el R2 es 1, el modelo le permite predecir perfectamente la puntuación del examen de cualquier persona.

Puede ver en el primer conjunto de datos que cuando el R2 es alto, las observaciones están cerca de las predicciones del modelo. En otras palabras, la mayoría de los puntos están cerca de la línea de mejor ajuste:

Por el contrario, puede ver en el segundo conjunto de datos que cuando el R2 es bajo, las observaciones están lejos de las predicciones del modelo. En otras palabras, cuando el R2 es bajo, muchos puntos están lejos de la línea de mejor ajuste:

Puede elegir entre dos fórmulas para calcular el coeficiente de determinación (R²) de una regresión lineal simple. La primera fórmula es específica de las regresiones lineales simples, y la segunda fórmula se puede usar para calcular la r² de muchos tipos de modelos estadísticos.

¿Qué significa el coeficiente de determinación?

Por ejemplo, un fabricante puede haber encontrado a través de un análisis de regresión lineal simple que involucra 15 observaciones mensuales de que el 64% del cambio en el costo total de la electricidad (la variable dependiente) se asoció con el cambio en las horas mensuales de la máquina de producción (la variable independiente) . En este ejemplo, el coeficiente de determinación es 0.64 o 64%.

El coeficiente de determinación se simboliza por R-cuadrado, donde R es el coeficiente de correlación. Por lo tanto, un coeficiente de determinación de 0.64 o 64% significa que el coeficiente de correlación fue de 0.8 u 80%. (El rango para el coeficiente de correlación es -1 a +1 y, por lo tanto, el rango para el coeficiente de determinación es de 0 a +1).

Es importante tener en cuenta que un alto coeficiente de determinación no garantiza que exista una relación de causa y efecto. Sin embargo, una relación de causa y efecto entre la variable independiente y la variable dependiente dará como resultado un alto coeficiente de determinación.

¿Qué pasa cuando el coeficiente de determinación es negativo?

Entiendo que $ R^2 $ no puede ser negativo, ya que es el cuadrado de R. Sin embargo, ejecuté una regresión lineal simple en SPSS con una sola variable independiente y una variable dependiente. Mi salida de SPSS me da un valor negativo por $ r^2 $. Si tuviera que calcular esto a mano desde r, entonces $ r^2 $ sería

positivo. ¿Qué se ha hecho SPSS para calcular esto como negativo?

$ R^2 $ compara el ajuste del modelo elegido con el de una línea recta horizontal (la hipótesis nula). Si el modelo elegido se ajusta peor que una línea horizontal, entonces $ R^2 $ es negativo. Tenga en cuenta que $ r^2 $ no es siempre el cuadrado de nada, por lo que puede tener un valor negativo sin violar ninguna regla matemática. $ R^2 $ es negativo solo cuando el modelo elegido no sigue la tendencia de los datos, por lo que encaja peor que una línea horizontal.

Ejemplo: ajuste los datos a un modelo de regresión lineal restringido para que el $ y $ intercept sea igual a $ 1500 $.

El modelo no tiene sentido en absoluto dados estos datos. Es claramente el modelo incorrecto, tal vez elegido por accidente.

El ajuste del modelo (una línea recta limitada para pasar por el punto (0,1500)) es peor que el ajuste de una línea horizontal. Por lo tanto, la suma de cuadrados del modelo $ (ss_ text {res}) $ es mayor que la suma de cuadrados de la línea horizontal $ (ss_ text {tot}) $.

Si $ r^2 $ se calcula como $ 1 – frac {ss_ text {res}} {ss_ text {Tot}} $.

(Aquí, $ ss_ {res} $ = error residual.)

Cuando $ ss_ text {res} $ es mayor que $ ss_ text {tot} $, esa ecuación podría calcular un valor negativo para $ r^2 $, si el valor del coeficiente es mayor que 1.

¿Qué significa el R2 en estadística?

R-cuadrado es una medida de bondad de ajuste para modelos de regresión lineal. Esta estadística indica el porcentaje de la varianza en la variable dependiente que las variables independientes explican colectivamente. R-cuadrado mide la fuerza de la relación entre su modelo y la variable dependiente en una conveniente escala del 0-100%.

Después de ajustar un modelo de regresión lineal, debe determinar qué tan bien el modelo se ajusta a los datos. ¿Hace un buen trabajo al explicar los cambios en la variable dependiente? Existen varias estadísticas clave de bondad de ajuste para el análisis de regresión. En esta publicación, examinaremos R-Squared (R2), resaltaremos algunas de sus limitaciones y descubriremos algunas sorpresas. Por ejemplo, los pequeños valores de R cuadrado no siempre son un problema, ¡y los altos valores de R cuadrado no son necesariamente buenos!

La regresión lineal identifica la ecuación que produce la menor diferencia entre todos los valores observados y sus valores ajustados. Para ser precisos, la regresión lineal encuentra la menor suma de residuos cuadrados que es posible para el conjunto de datos.

Los estadísticos dicen que un modelo de regresión se ajusta bien a los datos si las diferencias entre las observaciones y los valores predichos son pequeños e imparciales. Imparcial en este contexto significa que los valores ajustados no son sistemáticamente demasiado altos o demasiado bajos en ningún lugar del espacio de observación.

Sin embargo, antes de evaluar las medidas numéricas de bondad de ajuste, como R-cuadrado, debe evaluar las parcelas residuales. Los gráficos residuales pueden exponer un modelo sesgado de manera mucho más efectiva que la salida numérica al mostrar patrones problemáticos en los residuos. Si su modelo está sesgado, no puede confiar en los resultados. Si sus parcelas residuales se ven bien, continúe y evalúe su R-cuadrado y otras estadísticas.

¿Que interpreta el R2?

La interpretación más común del Ricker es la forma en que el modelo de regresión se adapta a los datos observados. Por ejemplo, un 60% R-Quadrato revela que el 60% de los datos se adaptan al modelo de regresión. En general, una R cuadrada más alta indica un mejor ajuste para el modelo.

¿Qué indican los valores del coeficiente de correlación?

- Cuanto más se acerca a cero, más la correlación lineal es débil.

- Un valor R positivo es una indicación de una correlación positiva, en la que los valores de las dos variables tienden a aumentar en paralelo.

R se llama «coeficiente de correlación» y se calcula con la ayuda de un software estadístico. Estrictamente, el coeficiente de correlación no debe usarse para dos variables vinculadas por una relación de causa-efecto; De hecho, describe una relación simple entre dos variables.

En estadísticas, una correlación es una relación entre dos variables, de modo que cada valor del primero corresponde a un valor del segundo, siguiendo una cierta regularidad. La correlación no depende de una relación causa-efecto como de la tendencia de una variable a cambiar según otra.

Una generalización del coeficiente de Spearman es útil en situaciones en las que desea verificar que las observaciones tengan lugar en un orden particular, por ejemplo, cuando desea verificar que los valores mejoren entre un experimento y el otro.

¿Cómo entender si una variable y significativa? Si P es inferior a 0.05, por lo que se acerca mucho a 0, significa una probabilidad baja de que la diferencia observada pueda atribuirse al azar y, por lo tanto, hablamos de significación estadística.

¿Qué valor tiene R²?

Mientras que para la investigación de exploración, utilizando los datos transversales de la certificación, los valores de 0.10 son típicos. En la investigación académica que se centra en los problemas de marketing, los valores de R2 de 0.75, 0.50 o 0.25 pueden, como regulación aproximada, ser descritas respetuosamente como sustanciales, moderadas o débiles.

En general, cuanto mayor sea el R cuadrado, mejor será el modelo adecuado para sus datos.

Si desea continuar leyendo esta publicación en «¿Cuál es un buen valor de Square R?» Haga clic en el botón «Mostrar todos» y puede leer el resto del contenido de forma gratuita. Ebstomasborba.pt es un sitio especializado en tecnología, noticias, juegos y muchos otros temas que pueden interesarle. Si desea leer más información similar a ¿Cuál es un buen valor de Square R?

Finalmente, la propiedad clave del cuadrado R-cuadrado, un valor de 0.5 significa que el modelo explica la mitad de la varianza en la variable de resultado. A veces, el R² se presenta porcentaje (por ejemplo, 50%).

R ^ 2 de 0.2 es en realidad para los datos del mundo real. Significa que el 20% completo de la variación de una variable se explica completamente por la otra.

El equipo R tiene valor, pero como muchas otras medidas, es esencialmente inútil en un vacío. Algunos ejemplos: se utilizará para determinar si una transformación en un paraguas de regreso se adapta el modelo. Se utilizará R 2 Pụ regulado para comparar el modelo en forma con diferentes subconjuntos de regresores.

¿Cuánto es un buen R2?

Anteriormente, expliqué cómo interpretar R-cuadrado. Mostré cómo la interpretación de R2 no siempre es sencilla. Un R-cuadrado bajo no siempre es un problema, y un alto R cuadrado no indica automáticamente que tenga un buen modelo.

Entonces, ¿qué tan alto debería ser R-cuadrado? La respuesta definitiva es. . . depende. Necesitará algo de paciencia porque mi afirmación es que esta pregunta es la pregunta incorrecta. En esta publicación, revelo por qué es la pregunta incorrecta y qué preguntas debe hacer.

¿Qué tan alto debe ser R-Squared? Si lo piensa, solo hay una respuesta correcta. R-cuadrado debe reflejar con precisión el porcentaje de la variación variable dependiente que explica el modelo lineal. Su R2 no debe ser más alto o más bajo que este valor.

El valor R2 correcto depende de su área de estudio. Diferentes preguntas de investigación tienen diferentes cantidades de variabilidad que son inherentemente inexplicables. Caso en cuestión, los humanos son difíciles de predecir. Cualquier estudio que intente predecir el comportamiento humano tenderá a tener valores R cuadrado inferiores al 50%. Sin embargo, si analiza un proceso físico y tiene muy buenas mediciones, puede esperar que los valores de R cuadrado sean superiores al 90%. No existe una mejor respuesta para cuán alto debería ser R-cuadrado.

En consecuencia, la respuesta a «¿Qué tan alto debe ser R-cuadrado?» es que depende de la cantidad de variabilidad que realmente es explicable. Claramente, su cuadrado R no debe ser mayor que la cantidad de variabilidad que realmente es explicable, lo que puede suceder en regresión. Para ver si su cuadrado R está en el estadio correcto, compare su R2 con los de otros estudios.

¿Qué valor de R2 es bueno?

Analicé el contenido de 43,110 trabajos de investigación elegidos al azar de PubMed para aprender más sobre R-cuadrado.

Específicamente, quería responder a las siguientes preguntas:

- ¿Cuál es un buen valor para R-cuadrado?

- ¿Cuál es un valor bajo para R-cuadrado?

- ¿Es un mayor R-cuadrado siempre mejor?

- ¿Es un bajo R-cuadrado necesariamente malo?

Comencemos con un breve resumen de los resultados antes de sumergirnos en el análisis detallado de los datos.

1. Solo el 33.4% de los estudios que utilizaron regresión lineal informaron el valor R cuadrado.

2. El valor promedio de R cuadrado en la investigación médica es 0.499, lo que significa que el modelo de regresión lineal promedio explica el 49.9% de la varianza de resultado.

3. No existe un umbral natural contra el cual podemos juzgar si un valor R cuadrado es demasiado alto o demasiado bajo.

4. Los valores de R cuadrado cerca de ambos extremos son bastante comunes en la investigación médica. De hecho, el 10% de los modelos de regresión tienen un cuadrado R por debajo de 0.035, y el 10% tiene un cuadrado R por encima de 0.979.

5. Un valor R-cuadrado más alto no es necesariamente mejor, ya que existe una correlación muy débil entre el valor de R-cuadrado y la calidad de la revista en la que se publicó el resultado.

6. Un valor R-cuadrado bajo no es un indicador de investigación de baja calidad, ya que obtener un valor R-cuadrado bajo no es un predictor estadísticamente significativo del factor de impacto de la revista bajo.

De 43,110 trabajos de investigación analizados, 4460 informaron el uso de un modelo de regresión lineal. De estos, solo 1490 (o 33.4%) informaron el valor R cuadrado.

¿Qué significa que R2 sea bajo?

Realicé una regresión con 4 variables, y todas son muy estadísticamente significativas, con valores t $ aproximadamente 7,9,26 $ y $ 31 $ (digo $ aprox $ porque parece irrelevante incluir los decimales) que son muy altos y claramente significativo. Pero entonces el $ r^2 $ es solo .2284. ¿Estoy malinterpretando los valores de T aquí para significar algo que no son? Mi primera reacción al ver los valores T fue que el $ R^2 $ sería bastante alto, pero ¿tal vez eso es un alto $ R^2 $?

Los valores de $ T $ y $ r^2 $ se utilizan para juzgar cosas muy diferentes. Los valores $ T $ se utilizan para juzgar el precurario de su estimación de los $ beta_i $ s, pero $ r^2 $ mide la cantidad de variación en su variable de respuesta explicada por sus covariables. Supongamos que está estimando un modelo de regresión con $ n $ observaciones,

$$

Y_i = beta_0 + beta_1x_ {1i} +… + beta_kx_ {ki} + epsilon_i

$$

donde $ epsilon_i overset {i.i.d} { sim} n (0, sigma^2) $, $ i = 1,…, n $.

Grandes valores de $ T $ (en valor absoluto) lo llevan a rechazar la hipótesis nula de que $ beta_i = 0 $. Esto significa que puede estar seguro de que ha estimado correctamente el signo del coeficiente. Además, si $ | t | $> 4 y tiene $ n> 5 $, entonces 0 no está en un intervalo de confianza del 99% para el coeficiente. El valor $ t $ para un coeficiente $ beta_i $ es la diferencia entre la estimación $ hat { beta_i} $ y 0 normalizada por el error estándar $ se { hat { beta_i} } $.

Artículos Relacionados: