Una prueba estadística de F utiliza una estadística F para comparar dos variaciones, S1 y S2, dividiéndolas. El resultado es siempre un número positivo (porque las variaciones siempre son positivas). La ecuación para comparar dos variaciones con la prueba F es:

F = S21 / S22

Si las variaciones son iguales, la relación de las variaciones es igual a 1. Por ejemplo, si tuviera dos conjuntos de datos con una muestra 1 (varianza de 10) y una muestra 2 (varianza de 10), la relación sería 10/10 = 1.

Siempre prueba que las variaciones de la población son iguales cuando se ejecutan una prueba F. En otras palabras, siempre asume que las variaciones son iguales a 1. Por lo tanto, su hipótesis nula siempre será que las variaciones son iguales.

Se hacen varios supuestos para la prueba. Su población debe distribuirse aproximadamente normalmente (es decir, ajustar la forma de una curva de campana) para usar la prueba. Además, las muestras deben ser eventos independientes. Además, querrás tener en cuenta algunos puntos importantes:

- La varianza más grande siempre debe ir en el numerador (el número superior) para forzar la prueba en una prueba de cola derecha. Las pruebas de cola derecha son más fáciles de calcular.

¿Necesita ayuda con una pregunta específica? ¡Vea nuestra página de tutoría! Advertencia: las pruebas F pueden ser realmente tediosas para calcular a mano, especialmente si tiene que calcular las variaciones. Estás mucho mejor usando la tecnología (como Excel, ver a continuación).

Estos son los pasos generales a seguir. Desplácese hacia abajo para obtener un ejemplo específico.

¿Qué es prueba de Fisher para varianzas?

La prueba de variaciones requiere que las dos poblaciones muestreadas se distribuyan normalmente y que las muestras se seleccionen aleatoriamente de sus respectivas poblaciones.

El método es simple; Consiste en tomar la relación entre la mayor varianza de la población, ( sigma_1^2 ), y la varianza de población más pequeña, ( sigma_2^2 ), luego mira la relación en una distribución (f )- curva. La hipótesis nula establece que la relación es igual a 1, [

H_o: frac { sigma_1^2} { sigma_2^2} = 1

] y la hipótesis alternativa establece que la relación difiere de 1 (es decir, las variaciones difieren), [

H_a: frac { sigma_1^2} { sigma_2^2} neq 1

] o es mayor que 1 (es decir, ( sigma_1^2 ) es significativamente más grande que ( sigma_2^2 )), [

H_a: frac { sigma_1^2} { sigma_2^2} gt 1

]

Dado que la mayor varianza se asigna al numerador por convención, no tenemos una situación en la que la relación es inferior a 1.

Como estamos trabajando con muestras, trabajamos con las variaciones de muestra (S_1^2 ) y (S_2^2 ) y calculamos la estadística de prueba (f ) como sigue: [[

F = frac {S_1^2} {S_2^2}

]

La forma de la curva de distribución ( pmb f ) se define por ambas muestras (df ) ’s, es decir, ((n_1-1) ) y ((n_2-1) ). Al igual que la distribución ( chi^2 ), la distribución (f ) tiende a ser sesgada a la derecha, especialmente para grandes (df ) ’s.

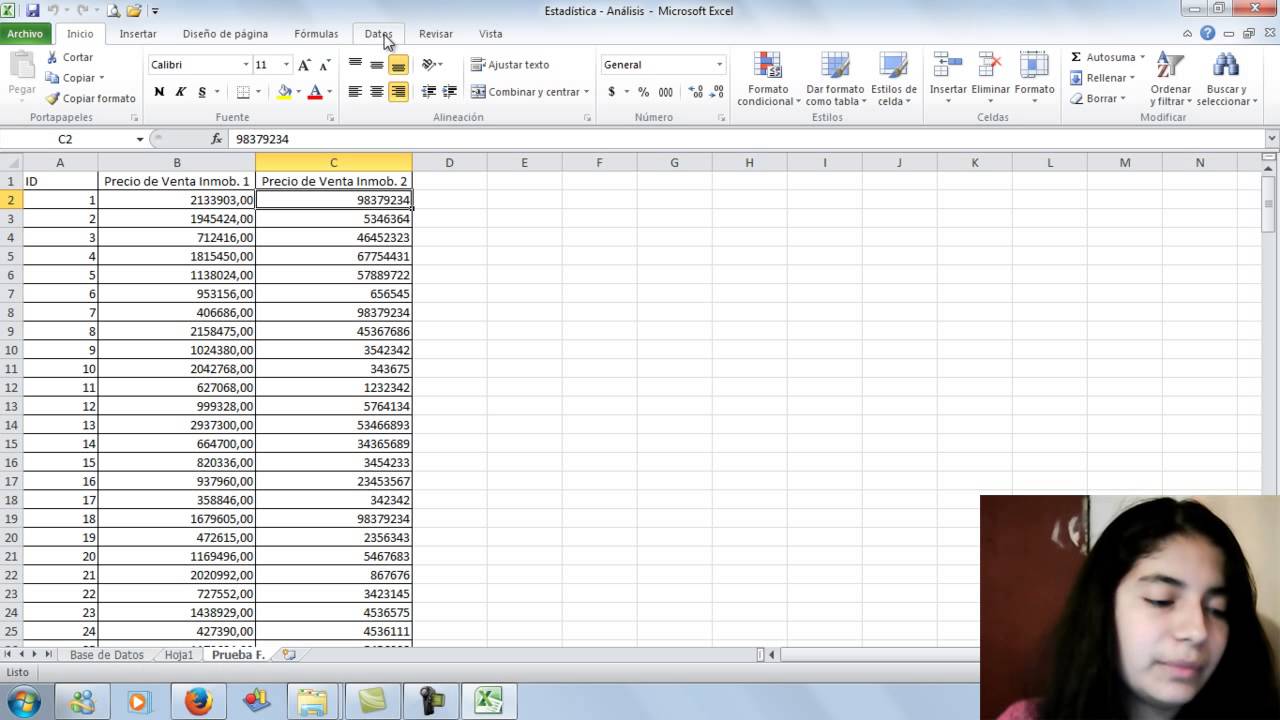

En uno de los ejemplos en la sección de prueba (z ) y (t ), buscamos comparar la concentración de sulfatos entre un sitio de fondo y un pozo contaminado (datos tomados de Millard et al., P. 418) . ¿Las dos muestras tenían variaciones iguales? La tabla de concentraciones se reproduce aquí.

¿Qué es la prueba F de Fisher?

Y primero, ¿por qué hacer tal pregunta? A menudo, para validar la hipótesis de su igualdad (llamada homoscedasticidad), una condición sinusoidal del uso de la prueba t (comparación de promedios). Además, el uso acoplado de estas dos pruebas permite validar la inclusión de dos muestras a la misma población (la prueba de la F para las variaciones que la de T para las expectativas). Consulte la página de comparación de dos poblaciones a este respecto.

Esta búsqueda de igualdad también constituye el problema del ANOVA (igualdad de una varianza intra-clase y una varianza entre clases) y la correlación (comparación de una varianza explicada por una regresión con una varianza residual en la ayuda del coeficiente de determinación). Como parte de una puntuación que discrimina a dos grupos, la prueba Fisher-Snedecor se lleva a cabo en cada variable digital para verificar la hipótesis de la homoscedasticidad: esta es una de las condiciones de uso del análisis discriminatorio lineal. La prueba de varianza, definitivamente útil para todos, también sirve al pronóstico para detectar estacionalidad y, al mismo tiempo, la existencia de una tendencia.

Sin embargo, sucede que la prueba de varianza proporciona directamente conclusiones: la comparación de las distribuciones salariales, la volatilidad en los mercados financieros, los rendimientos agrícolas… una opción que favorece el menor riesgo puede ser argumentado por una menor varianza. Pero es especialmente en el campo industrial y particularmente en los controles de calidad que se utiliza esta prueba. Una máquina bien ajustada fabrica productos cuyas mediciones tienen una varianza más baja que si fueran mecanizadas por una máquina que es demasiado antigua o mal ajustada.

Cuando resumen la dispersión de muestras y no una población total, nuestras variaciones son variables aleatorias (V.A). Puede encontrar una muestra muy dispersa o, por el contrario, en una muestra más homogénea. La diferencia observada entre los dos puede provenir de las fluctuaciones de muestreo, a menos que las variaciones sean demasiado diferentes. Pero el riesgo de error aún permanece. Por lo tanto, determinaremos este borde entre similar y diferente, dependiendo de un nivel de confianza dado.

¿Cuándo se utiliza la distribución F de Fisher?

La prueba exacta de Fisher es una prueba de significancia utilizada por estadísticas no paramétricas para verificar la hipótesis.

Toma su nombre de su fundador, Ronald Fisher, el matemático/estadística que fundó los conceptos en los que se basan las estadísticas matemáticas modernas.

La prueba le permite verificar si lo diferente entre los datos puede deberse al caso; En el caso de que la prueba demuestre que no pueden ser el resultado del caso, hablamos de «significación estadística».

Se usa en situaciones donde hay dos variables nominales dicotómicas y pequeños campeones. El objetivo de la prueba es verificar si los datos dicotómicos de dos muestras resumidas en una tabla de contingencia 2 × 2 son compatibles con la hipótesis H0 (nada de hipótesis) de que las dos muestras tienen la misma división dicotómica y, por lo tanto, cualquier diferencia observada a través de Los datos se deben a un caso puro y simple.

Si las muestras examinadas son suficientemente grandes, es posible utilizar la prueba de cuya pintura con 1 grado de libertad.

La diferencia entre las dos pruebas radica en el hecho de que si bien la de la plaza que es exactamente de manera activa solo por dimensiones muy grandes de los campeones, la prueba de Fisher siempre es exacta.

ANOVA es el acrónimo para el análisis de varianza, una expresión con la que se identifican un conjunto de técnicas relacionadas con estadísticas inferenciales.

A través del desarrollo de la fórmula de varianza, es posible comparar dos o más grupos de datos, comparando la variabilidad interna con estos grupos con la variabilidad entre los grupos.

¿Cuándo se utiliza la prueba F?

El investigador realiza una prueba F sobre la base de la estadística F. La estadística F se define como la relación entre las dos variadas independientes de Chi Square que se dividen por su respectivo grado de libertad. La prueba F sigue la distribución F del Snedecor.

La prueba F contiene algunas aplicaciones que se utilizan en la teoría estadística. Este documento detallará las aplicaciones.

El investigador utiliza la prueba F para llevar a cabo la prueba de la igualdad de las dos variaciones de población. Si un investigador quiere probar si se han extraído o no dos muestras independientes de una población normal con la misma variabilidad, entonces generalmente emplea la prueba F.

Alinear el marco teórico, la recopilación de artículos, sintetizar brechas, articular una metodología y plan de datos claros, y escribir sobre las implicaciones teóricas y prácticas de su investigación son parte de nuestros servicios integrales de edición de tesis.

- Rastree todos los cambios, luego trabaje con usted para lograr una escritura académica.

- Apoyo continuo para abordar los comentarios del comité, reduciendo las revisiones.

El investigador también utiliza la prueba F para determinar si las dos estimaciones independientes de las variaciones de la población son de naturaleza homogénea.

Un ejemplo que representa el caso anterior en el que se aplica la prueba F es, por ejemplo, si dos conjuntos de calabazas se cultivan en dos condiciones experimentales diferentes. En este caso, el investigador seleccionaría una muestra aleatoria de tamaño 9 y 11. Las desviaciones estándar de sus pesos son 0.6 y 0.8 respectivamente. Después de suponer que la distribución de sus pesos es normal, el investigador realiza una prueba F para probar la hipótesis de si las variaciones verdaderas son iguales o no.

¿Cuándo se usa la distribución Fisher?

La prueba de Pearson Chi-Quadro es válida «asintótica», es decir, si el tamaño de la muestra es muy elegido. Por el contrario, si en una tabla de contingencia, al menos una celda resalta una frecuencia muy baja (en la práctica, por debajo de 5), se usa la prueba exacta de Fisher.

Pruebas que asuman un papel fundamental en la metodología estadística del análisis de la varianza (ver ANOVA). Le permite verificar la homogeneidad (v.) De las variaciones de dos poblaciones que tienen distribuciones normales.

La prueba t de Student para muestras independientes se usa para determinar si hay una diferencia estadísticamente significativa entre los promedios de dos grupos independientes. Por ejemplo, puede usar esta prueba para evaluar si hay una diferencia en los tiempos de espera promedio en la sala de emergencias entre dos hospitales diferentes.

Calcule la estimación de F. El valor F se determina usando la receta F = (SSE1-SSE2/M)/SSE2/N-K, donde SSE = Total de los cuadrados restantes, M = Limitaciones y K = número de factores libres. Encuentre estadísticas F (el valor crítico para esta prueba).

En las estadísticas, la prueba F para la comparación de dos variaciones es una prueba de hipótesis basada en la distribución de fisher-snedecor y tiene como objetivo verificar la hipótesis de que dos poblaciones que siguen ambas distribuciones normales tienen la misma varianza.

¿Cómo se usa ANOVA de alguna manera? El análisis de la varianza a una forma en general se usa cuando tiene una sola variable o factor independiente, y desea verificar si alguna variación o niveles diferentes de este factor tienen un efecto medible en una variable dependiente.

¿Qué es la prueba F para varianzas de dos muestras?

Para remediar esto, se introdujo el análisis de la varianza o ANOVA (análisis de varianza), lo que permite precisamente comparar más de dos grupos de datos con un error mínimo.

Indicando con $ mu_1, mu_2, dots, mu_k $ el medio de las poblaciones al que pertenecen los grupos k respectivamente, el sistema de hipótesis es el siguiente: $$ begin {casos} h_0: mu_1 = mu_2 = dots = mu_k \ h_1: mbox {al menos uno de los grupos tiene medio $ mu_i $ diferente de los otros} end {casos} $$

Para verificar estas hipótesis, debemos calcular la desviación total, la desviación entre los grupos, la desviación dentro de los grupos (haga clic aquí para obtener más información) y los grados de libertad de cada uno.

Revisemos juntas las fórmulas para el cálculo de las 3 desviaciones y los grados de libertad correspondientes: $$ begin {eqnarray} dev_ {tot} & = & sum limits_ {i = 1}^k sum limits_ {j = 1}^{n_i} x_ {ij}^2-n cdot m (x)^2 quad ( mbox {g.d.l.} = n-1) \ dev_ {entre} & = & sum limits_ { I = 1}^kn_i [m (x | a_i) -m (x)]^2 quad ( mbox {g.d.l.} = k -1) \ dev_ {dentro} & = & sum limits_ {i = 1}^k sum limits_ {j = 1}^{n_i} (x_ {ij} -m (x | a_i))^2 quad ( mbox {g.d.l.} = n -k)) end {eqnarray} $ $ donde con $ x $ indicó la variable que adquiere todos los valores extraídos de la población y con $ m (x) $ su promedio, con $ m (x | a_i) $ los promedios parciales de cada grupo y con $ n $ El número total de observaciones de muestra.

Como se explica aquí, de las desviaciones podemos derivar las variaciones dividiendo por sus respectivos grados de libertad. En particular, tenemos: $$ begin {eqnarray} var_ {entre} & = & franc {dev_ {entre}} {k-speed} \ var_ {dentro} & = & franc {dev_ {by}} {n-k} end {eqnarray} $$

¿Qué sé prueba con la distribución F?

Una distribución de probabilidad, como la distribución normal, es el medio para determinar la probabilidad de que ocurra un conjunto de eventos. Esto también es cierto para la distribución F.

La distribución F es una distribución sesgada de probabilidades similar a una distribución de chi cuadrado. Pero donde la distribución Chi-cuadrado se ocupa del grado de libertad con un conjunto de variables, la distribución F se ocupa de múltiples niveles de eventos que tienen diferentes grados de libertad. Esto significa que hay varias versiones de la distribución F para diferentes niveles de grados de libertad.

Cada curva representa diferentes grados de libertad. Esto significa que el área requerida para que la prueba sea significativa es diferente. Si se siente matemáticamente aventurero, la ecuación real para la curva de distribución F es

Dado que los grados de libertad están en la ecuación, es bastante fácil ver que la curva cambia a medida que cambian los grados de libertad.

Rara vez tiene que lidiar con la construcción de una curva real porque el software estadístico lo hace por usted. Sin embargo, tendrá que usar el concepto de curva en ciertas configuraciones experimentales.

La prueba F, que utiliza la distribución, es una cuestión de comparar múltiples niveles de variables independientes con múltiples grupos. Esto se encuentra comúnmente en ANOVA y ANOVA factorial.

Consideremos que está probando un nuevo medicamento para la enfermedad cardíaca llamada X. En este caso, desea determinar los efectos significativos de las diferentes dosis. Entonces, siendo el gran estadístico que eres, establece ensayos de 0 mg, 50 mg y 100 mg de x en tres grupos seleccionados al azar de 30 cada uno. Este es un caso para ANOVA, que utiliza la distribución F.

¿Qué indica la prueba F?

Cuando se ajuste a un modelo de regresión a un conjunto de datos, recibirá una tabla de regresión como salida, lo que le indicará la estadística F junto con el valor p correspondiente para esa estadística F.

Si el valor p es menor que el nivel de significancia que ha elegido (las opciones comunes son .01, .05 y .10), entonces tiene evidencia suficiente para concluir que su modelo de regresión se ajusta mejor a los datos que el solo de intercepción modelo.

Supongamos que tenemos el siguiente conjunto de datos que muestra el número total de horas estudiadas, los exámenes de preparación totales tomados y el puntaje final del examen recibido para 12 estudiantes diferentes:

Para analizar la relación entre las horas estudiadas y los exámenes de preparación tomados con el puntaje final del examen que recibe un estudiante, realizamos una regresión lineal múltiple utilizando horas estudiadas y exámenes de preparación tomados como las variables predictoras y la puntuación del examen final como la variable de respuesta.

A partir de estos resultados, nos centraremos en la estadística F dada en la tabla ANOVA, así como en el valor p de esa estadística F, que se etiqueta como significancia F en la tabla. Elegiremos .05 como nuestro nivel de significancia.

Dado que el valor p es menor que el nivel de significancia, podemos concluir que nuestro modelo de regresión se ajusta mejor a los datos que el modelo de intercepción.

En el contexto de este problema específico, significa que el uso de nuestras variables predictoras de las horas de estudio y los exámenes de preparación en el modelo nos permite adaptarse mejor a los datos que si los dejamos fuera y simplemente usamos el modelo de intercepción solo.

¿Qué es la prueba de distribución Fisher?

En mi trabajo, he visto varios usos de la prueba exacta de Fisher, y me preguntaba qué tan bien se ajusta a mis datos. Al observar varias fuentes, entendí cómo calcular la estadística, pero nunca vi una explicación clara y formal de la hipótesis nula supuesta.

¿Alguien puede explicarme o referirme a una explicación formal de la distribución supuesta? Agradecerá una explicación en términos de los valores en la tabla de contingencia.

En el caso de $ 2 Times 2 $, el supuesto de distribución está dado por dos variables aleatorias binomiales independientes $ X_1 SIM bin (n_1, theta_1) $ y $ x_2 sim bin (n_2, theta_2) $. La hipótesis nula es la igualdad $ theta_1 = theta_2 $.

Pero la prueba exacta de Fisher es una prueba condicional: se basa en la distribución condicional de $ x_1 $ dada $ x_1+x_2 $. Esta distribución es una distribución hipergeométrica con un parámetro desconocido: el odds ratio $ psi = frac { frac { theta_1} {1- theta_1}} { frac { theta_2}} {1- theta_2}} $, Y luego la hipótesis nula es $ psi = 1 $.

- Las dos variables que se evalúan para la asociación son variables verdaderamente politomosas de todo o nada, como Dead/Alive US/Europe. Si una o ambas variables es una simplificación de un continuo subyacente, el análisis de datos categóricos no debe realizarse en absoluto.

- No hay otras variables de fondo relevantes. Si $ y $ es la variable de resultado y $ x $ es una variable que se evalúa para asociación con $ y $, la probabilidad de que $ y = y $ sea idéntico para cada sujeto con $ x $ fijado a $ x $. Las tablas de contingencia suponen en efecto que no hay heterogeneidad en la distribución de $ y $ que no se contabilice por $ x $. Por ejemplo, en un ensayo clínico aleatorizado que estudia el efecto del tratamiento A versus B sobre la probabilidad de muerte, una prueba de tabla de contengencia de $ 2 veces 2 $ supone que cada sujeto en el tratamiento A tiene la misma probabilidad de muerte. [Se podría argumentar que esta es una suposición demasiado estricta, pero esa posición no reconoce la pérdida de poder de hacer pruebas de asociación no ajustadas.]

La prueba de Fisher hace una suposición no realizada por pruebas de asociación incondicionales como la prueba $ chi^2 $ de Pearson: que estamos interesados en la distribución marginal «actual» de $ x $ y $ y $, es decir, estamos acondicionando en las frecuencias de las categorías de resultados de $ y $. Esto no es razonable para estudios prospectivos. El uso de la prueba de Fisher conduce al conservadurismo. Sus valores de $ P $ son en promedio demasiado grandes, porque la prueba garantiza que los valores de $ P $ no son demasiado pequeños. En promedio, los valores Pearson $ chi^2 $ P $ son más accesorios que los de Fisher, incluso con frecuencias esperadas muy inferiores a 5 en algunas de las células.

Artículos Relacionados: