Los métodos no paramétricos se utilizan para analizar los datos cuando no se cumplen los supuestos de distribución de los procedimientos más comunes. Por ejemplo, muchos procedimientos estadísticos suponen que la distribución de errores subyacentes es gaussiana, de ahí el uso generalizado de medias y desviaciones estándar. Cuando no se conoce la distribución de errores, las pruebas estadísticas no paramétricas pueden ser más seguras de aplicar. Los métodos no paramétricos en Statgraphics son opciones dentro de los mismos procedimientos que aplican las pruebas clásicas. Estos métodos estadísticos no paramétricos se clasifican a continuación de acuerdo con su aplicación.

Las pruebas de bondad de ajuste se utilizan para comparar la frecuencia de aparición de observaciones (cuantitativas o categóricas) con un modelo probabilístico. Las pruebas específicas incluyen la prueba de bondad de ajuste de chi-cuadrado, la prueba Kolmogorov-Smirnov y la prueba de Anderson-Darling.

Cuando los datos se recopilan de dos poblaciones tomando muestras independientes, las estadísticas de prueba se pueden crear sin asumir que las observaciones de las poblaciones se distribuyen normalmente. El procedimiento de comparación de dos muestras realiza una prueba de Mann-Whitney (Wilcoxon) para comparar las medianas y una prueba de Kolmogorov-Smirnov de dos lados para comparar todas las distribuciones.

Cuando se recopilan datos de más de dos poblaciones, el procedimiento de análisis de muestras múltiples puede probar diferencias significativas entre las medianas de población utilizando una prueba de Kruskal-Wallis, la prueba media del estado de ánimo o la prueba de Friedman. También puede crear gráficos de caja y bigotes con muescas, que tienen la propiedad de que 2 muestras con muescas medianas que no se superponen demuestran una diferencia estadísticamente significativa entre sus respectivas medianas de población.

El procedimiento de análisis de variables múltiples calculará las correlaciones entre pares de variables utilizando los coeficientes de correlación de productos de productos de Pearson, o las correlaciones de clasificación utilizando el método de Kendall o Spearman. La tabla a la derecha muestra correlaciones estimadas, tamaño de muestra y valores p aproximados para 4 variables demográficas.

Para los datos categóricos, se pueden calcular varias medidas de asociación entre los niveles de dos factores en el procedimiento de tablas de contingencia. La tabla a la izquierda muestra estadísticas para una tabla típica de 2 por 2.

¿Qué son los métodos estadístico no paramétricos?

Existen diferentes tipos de distribuciones de probabilidad en las que funcionan las estadísticas paramétricas. Ahora, cuando no sabemos qué tipo de distribución de probabilidad corresponde a una variable, ¿qué cálculos usamos?

Es decir, cuando no conocemos la distribución de la probabilidad de un conjunto de datos, debemos hacer inferencias estadísticas con procedimientos no paramétricos.

En otras palabras, si no sabemos qué tipo de distribución de probabilidad tiene un fenómeno, no podemos hacer estimaciones como si realmente supiéramos cómo se distribuye. Este es el objetivo de las estadísticas paramétricas, permitirnos conocer la distribución para que podamos pasar al siguiente paso (estadísticas paramétricas).

Por supuesto, si no sabemos cómo se distribuye un fenómeno aleatorio, ¿qué debemos hacer? Muy fácil. Nuestra misión será tratar de saber cómo se distribuye. Para tratar de averiguar qué tipo de distribución tiene un cierto fenómeno, tenemos una serie de pruebas que nos ayudan a hacerlo. Entre las pruebas no paramétricas más populares están:

- prueba binomial

- Prueba de Anderson-Darling

- Prueba de Cochran

- Prueba de Cohen Kappa

- Prueba de pescadores

- Prueba de Friedman

- Prueba de Kendall

- Prueba de Kolmogóros-Smnerov

- Prueba de kuiper

- Prueba de Mann-Whitney o prueba de Wilcoxon

- Prueba de McNemar

- prueba media

- Prueba de Siegel-Tukey

¿Qué son los métodos estadísticos contra no paramétricos?

Las pruebas estadísticas no paramétricas pueden ser una alternativa útil a las pruebas estadísticas paramétricas cuando no se cumplen los supuestos de prueba sobre la distribución de datos.

En este número de anestesia y analgesia, Wang et al1 informan los resultados de un ensayo de los efectos de la masticación preoperatoria de la goma en el dolor de garganta tras anestesia general con un dispositivo de vía aérea supraglótica. Los autores utilizaron la prueba U de Mann-Whitney, una prueba no paramétrica, para comparar las puntuaciones de dolor de escala de calificación numérica entre los grupos.

La mayoría de los métodos estadísticos, es decir, métodos paramétricos, se basan en el supuesto de una distribución de datos específica en la población de la cual se muestrearon los datos. Esta distribución se caracteriza por ≥1 parámetros, como la media y la varianza para la distribución normal (gaussiana, en forma de campana «). Los métodos paramétricos comúnmente buscan estimar los parámetros de la población y probar hipótesis en estos parámetros, por ejemplo, en las medias y las diferencias medias entre los grupos. En contraste, aunque la definición exacta varía en la literatura, los métodos no paramétricos generalmente no asumen una distribución de probabilidad específica. Si bien existen otros métodos no paramétricos, nos centramos aquí en las pruebas no paramétricas basadas en rango ampliamente utilizadas. Estos métodos utilizan los rangos de los datos en lugar de sus valores reales y básicamente pueden usarse para todos los datos que pueden clasificarse, incluidos los datos ordinales, los datos discretos (como los recuentos) y los datos continuos.

¿Qué es estadística no paramétrica?

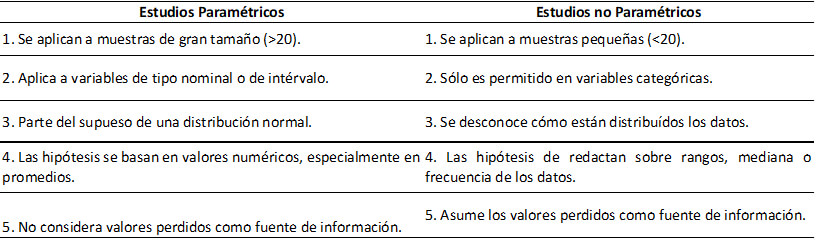

Las pruebas paramétricas y no paramétricas pueden usarse para evaluar las hipótesis, y la elección del procedimiento a utilizar depende del tipo de variables analizadas y sus propiedades. En general, las pruebas paramétricas se aplican a datos cuantitativos, como: B. La comparación del tiempo hasta la configuración de un bloqueo del nervio periférico (PNB) para pacientes obesos, de peso normal y delgado en un análisis de varianza de 1 vía. Por otro lado, las pruebas no paramétricas se pueden aplicar a datos cuantitativos, ordenados o cualitativos, como: B. La comparación del estado del cuerpo ASA y el género en un cuadrado chi de 6 x 2.

Los examinadores a menudo suponen que las pruebas paramétricas son las «mejores». Si una variable cuantitativa tiene la forma de la campana de la curva normal y los grupos comparados tienen una variabilidad similar, las pruebas paramétricas son realmente más poderosas para reconocer las diferencias de grupo que sus contrapartes no paramétricas.

Sin embargo, los analistas de datos no solo seleccionan pruebas debido a su significado. En el primer ejemplo, no se utilizaría un análisis de Chi Square, a menos que la distribución por el tiempo hasta que se coloque un PNB tenga una forma no normal que requiere que se divida en cuartos, por ejemplo, antes de dividirse en un 4 (Cuartiles de tiempo) comparados. x 3 (clases de peso) Chi Square. En el segundo ejemplo, una prueba t de Student no se utilizaría para comparar el estado físico de ASA entre hombres y mujeres, ya que el estado físico de ASA es una variable de rango no continua.

En resumen, la elección de la prueba debe determinarse por el tipo de variables que se analizarán y sus características de distribución. Dado que es probable que los estudios contengan todo tipo de datos, generalmente se informan los resultados de una mezcla de estos métodos. El próximo mes, las estadísticas en dosis pequeñas discutirán las hipótesis cero y alternativas que se abordan por las pruebas paramétricas y no paramétricas.

¿Qué son los métodos estadísticos paramétricos?

Las estadísticas son una rama de los estudios que nos permite comprender la dinámica de la población utilizando muestras tomadas de una cierta población de interés. Es esencial que estos campeones sean aleatorios. Muchas fórmulas se crean con la incorporación de matemáticas, para hacer inferencias en los parámetros de la población. Por supuesto, cualquier población puede tener una «distribución normal» en la que la dispersión de datos / muestras tiene una forma de campana en el gráfico de frecuencia. En una distribución normal, la mayoría de las muestras se centran en promedio y 68%, 95%, 99%de los datos son detectados por 1, 2 y 3 desviaciones estándar, respectivamente. Las estadísticas paramétricas y no paramétricas dependen del hecho de que la distribución normal se considera o no.

Las estadísticas paramétricas son las estadísticas en las que se considera que los datos / muestras se toman de una distribución normal. La definición de estadísticas paramétricas es «las estadísticas que presupone que los datos provienen de un tipo de distribución de probabilidad y realiza inferencias en los parámetros de distribución». Los métodos estadísticos elementales más conocidos pertenecen a este grupo. En realidad, pueden no distribuirse normalmente. Por lo tanto, este tipo de estadísticas se basa en múltiples hipótesis. Si los datos / muestras se distribuyen normalmente o casi normalmente, las fórmulas pueden producir resultados e inferencias precisas. Sin embargo, si la hipótesis de ser distribuida normalmente es incorrecta, las estadísticas paramétricas podrían ser bastante engañosas.

Las estadísticas no paramétricas también se conocen como estadísticas libres de distribución. La ventaja de este tipo de estadísticas es que no debe hacer una hipótesis como se hizo anteriormente con Parametrics. Los cálculos estadísticos no paramétricos tienen en cuenta los medios en comparación con las medias. Por lo tanto, si uno o dos se desvían con un valor promedio, se descuida su efecto. Las estadísticas paramétricas generalmente se prefieren porque tiene más poder para rechazar una hipótesis falsa que el método no paramétrico. Una de las pruebas no paramétricas más conocidas es la prueba del cuadrado. Existen análogos no paramétricos para algunas pruebas paramétricas como la prueba t de Wilcoxon para la prueba t de muestras aparecidas, la prueba U de Mann-Whitney para muestras de prueba t independientes, correlación de Spearman para la correlación de Pearson, etc. Para una muestra de prueba t, no hay una prueba comparativa no paramétrica.

¿Cuál es la diferencia entre paramétrico y no paramétrico?

• Las estadísticas paramétricas dependen de la distribución normal, pero las estadísticas no paramétricas no dependen de la distribución normal.

¿Qué son los métodos estadísticos deductivos paramétricos?

He leído este hilo, y me parece que se puede decir que:

- estadísticas = inducción?

- probabilidad = deducción?

Pero me pregunto si podría haber más detalles sobre la comparación que me estoy perdiendo. Por ejemplo, ¿las estadísticas son iguales a la inducción, o es solo un caso particular de ello? Parece que la probabilidad es un subcase de deducción (ya que es un sub caso de pensamiento matemático).

Sé que esta es una pregunta exigente, pero en cierto sentido, es por eso que lo estoy preguntando, porque quiero estar seguro de cómo estos términos se pueden comparar con precisión.

Creo que es lo mejor recapitular rápidamente el significado del razonamiento inductivo y deductivo antes de responder a su pregunta.

Razonamiento deductivo: «Los argumentos deductivos son intentos de demostrar que una conclusión necesariamente se deriva de un conjunto de premisas. Un argumento deductivo es válido si la conclusión sigue necesariamente de las premisas, es decir, si la conclusión debe ser verdadera que las premisas sean verdaderas . Un argumento deductivo es sólido si es válido y sus premisas son ciertas. (Citado de Wikipedia, énfasis agregado).

«El razonamiento inductivo, también conocido como inducción o lógica inductiva, o suposición educada en inglés coloquial, es un tipo de razonamiento que permite la posibilidad de que la conclusión sea falsa incluso cuando todas las premisas son ciertas. Las premisas de un argumento lógico inductivo Indique cierto grado de apoyo (probabilidad inductiva) para la conclusión, pero no lo implican; es decir, no aseguran su verdad «. (De Wikipedia, énfasis agregado)

¿Cuándo se usa la estadística paramétrica?

Las estadísticas inferenciales sugieren declaraciones sobre una población basada en una muestra de esa población. Las pruebas inferenciales paramétricas se llevan a cabo en datos que siguen ciertos parámetros: los datos serán normales (es decir, la distribución es paralela a la curva de campana); Los números se pueden agregar, restarse, multiplicarse y dividirse; Las variaciones son iguales al comparar dos o más grupos, y la muestra debe ser grande y seleccionada al azar.

En general, existen más opciones de técnica estadística para el análisis de datos paramétricos que no paramétricos, y las estadísticas paramétricas se consideran más poderosas. Ejemplos comunes de pruebas paramétricas son las pruebas t correlacionadas, Annova y ANCOVA.

Veamos cuáles son las estadísticas inferenciales. Las estadísticas inferenciales ayudan a sugerir explicaciones para una situación o fenómeno. Le permite sacar conclusiones basadas en extrapolaciones y de esa manera es fundamentalmente diferente de las estadísticas descriptivas que simplemente resumen los datos que realmente se han medido. Un ejemplo popular de estadísticas inferenciales es que las pruebas de hipótesis se usan para sacar suposiciones o algunas conclusiones de los datos de muestra realizando algunas pruebas de muestra.

Las estadísticas inferenciales paramétricas se utilizan cuando los datos están en la escala de intervalo o relación y cuando el resultado (variable dependiente) es continua y normalmente se distribuye.

- Pruebas t

- Análisis de variación

- Análisis de covarianza

- Correlación

- Análisis de regresión

Las pruebas se realizan principalmente para comparar dos grupos o dos conjuntos de datos en un mejor sentido, se utiliza para comparar la diferencia entre dos medios

¿Qué estadísticos se utilizan en las pruebas no paramétricas?

En esta sección, explico la prueba mediana para una muestra, una comparación de dos muestras emparejadas, una comparación de dos muestras independientes y una comparación de tres o más muestras. Los tipos de técnicas de análisis no paramétricas y las técnicas de análisis paramétricos correspondientes se delinean en la Tabla 1.

La prueba de signo y la prueba de rango firmada de Wilcoxon se utilizan para las pruebas medianas de una muestra. Estas pruebas examinan si una instancia de datos de muestra es mayor o menor que la mediana (valor de referencia).

La prueba de signo es la prueba más simple entre todas las pruebas no paramétricas con respecto a la ubicación de una muestra. Esta prueba examina la hipótesis sobre la mediana θ0 de una población, e implica probar la hipótesis nula H0: θ = θ0. Si el valor observado (xi) es mayor que el valor de referencia (θ0), se marca como +, y se le da un signo si el valor observado es menor que el valor de referencia, después de lo cual se calcula el número de valores + . Si hay un valor observado en la muestra que es igual al valor de referencia (θ0), dicho valor observado se elimina de la muestra. En consecuencia, el tamaño de la muestra se reduce para proceder con la prueba de signo. El número de instancias de datos de muestra dado el signo + se denota como ‘B’ y se conoce como estadística del signo. Si la hipótesis nula es verdadera, el número de signos + y el número de signos son iguales. La prueba de signo ignora los valores reales de los datos y solo usa signos + o -. Por lo tanto, es útil cuando es difícil medir los valores.

La prueba de signo tiene un inconveniente en que puede conducir a una pérdida de información porque solo se utilizan signos + o – en la comparación de los datos dados con el valor de referencia de θ0. En contraste, la prueba de rango firmada de Wilcoxon no solo examina los valores observados en comparación con θ0, sino que también considera los tamaños relativos, mitigando así la limitación de la prueba de signo. La prueba de rango firmada de Wilcoxon tiene más poder estadístico porque puede reducir la pérdida de información que surge solo de usar signos. Como en la prueba de signo, si hay un valor observado igual al valor de referencia θ0, este valor observado se elimina de la muestra y el tamaño de la muestra se ajusta en consecuencia. Aquí, dada una muestra con cinco puntos de datos (XI), como se muestra en la Tabla 2, probamos si la mediana (θ0) de esta muestra es 50.

Deje que la mediana (θ0) sea 50. Los datos originales se transformaron en datos de rango y signo. +/- media xi> 50 y <50 respectivamente. El soporte redondo significa rango.

¿Que estadístico se emplea en una correlación no paramétrica?

Los siguientes son tres tipos de coeficientes de correlación no paramétricos de uso común: (Spearman R, Kendall Tau y coeficientes gamma). Tenga en cuenta que la estadística de chi-cuadrado calculado para tablas de frecuencia bidireccional, también proporciona una medida cuidadosa de una relación entre las dos variables (tabuladas) y, a diferencia de las medidas de correlación enumeradas a continuación, se puede utilizar para variables que se miden en un Escala nominal simple.

Más importante aún, Kendall Tau y Spearman implican diferentes interpretaciones: Spearman R puede considerarse como el coeficiente regular de correlación del momento del producto Pearson, es decir, en términos de proporción de variabilidad explicada, excepto que Spearman R se calcula a partir de rangos. Kendall Tau, por otro lado, representa una probabilidad, es decir, es la diferencia entre la probabilidad de que en los datos observados las dos variables estén en el mismo orden en comparación con la probabilidad de que las dos variables estén en diferentes órdenes.

¿Cuáles son las pruebas estadísticas no paramétricas?

Este módulo describirá algunas pruebas no paramétricas populares para resultados continuos. Los lectores interesados deberían ver Conover3 para obtener una cobertura más completa de pruebas no paramétricas.

Las pruebas paramétricas son generalmente más poderosas y pueden probar una gama más amplia de hipótesis alternativas. Vale la pena repetir que si los datos se distribuyen aproximadamente normalmente, las pruebas paramétricas (como en los módulos en las pruebas de hipótesis) son más apropiadas. Sin embargo, hay situaciones en las que se violan los supuestos para una prueba paramétrica y una prueba no paramétrica es más apropiada.

Las técnicas descritas aquí se aplican a los resultados que son variables de resultados ordinales, clasificadas o continuas que normalmente no se distribuyen. Recuerde que los resultados continuos son medidas cuantitativas basadas en una escala de medición específica (por ejemplo, peso en libras, altura en pulgadas). Algunos investigadores hacen la distinción entre datos continuos, intervalos y ordinales a escala. Los datos de intervalo son como datos continuos, ya que se miden en una escala constante (es decir, existe la misma diferencia entre las puntuaciones de escala adyacentes en todo el espectro de puntajes). Las diferencias entre las puntuaciones de intervalo son interpretables, pero las relaciones no lo son. La temperatura en Celsius o Fahrenheit es un ejemplo de resultado de una escala de intervalo. La diferencia entre 30º y 40º es la misma que la diferencia entre 70º y 80º, pero 80º no es el doble de cálido que 40º. Los resultados ordinales pueden ser menos específicos ya que las categorías ordenadas no necesitan estar igualmente espaciadas. La gravedad de los síntomas es un ejemplo de un resultado ordinal y no está claro si la diferencia entre mucho peor y un poco peor es la misma que la diferencia entre no hay cambios y ligeramente mejorado. Algunos estudios utilizan escalas visuales para evaluar los signos y síntomas autoinformados de los participantes. El dolor a menudo se mide de esta manera, de 0 a 10 con 0 que no representan dolor y 10 representan dolor agonizante. Los participantes a veces se muestran una escala visual como la que se muestra en la parte superior de la figura a continuación y se les pide que elijan el número que mejor representa su estado de dolor. A veces, las escalas de dolor usan anclajes visuales como se muestra en la parte inferior de la figura a continuación.

¿Qué característica define la aplicación de los métodos estadísticos paramétricos y los no paramétricos?

La estrategia general mencionada anteriormente para evaluar las hipótesis estadísticas determina principalmente el uso de los métodos paramétricos llamados de las estadísticas matemáticas.

Los métodos paramétricos se basan en algunos, generalmente es muy probable que supuestamente el tipo de distribución de una variable aleatoria. Por lo general, los métodos paramétricos utilizados en el análisis de datos experimentales se basan en el supuesto de que la distribución de estos datos es normal. Una consecuencia de esta suposición es la necesidad de apreciar los parámetros de distribución distribuida. En el siguiente caso, la prueba de Estudiante T, tales parámetros estimados son la expectativa y varianza matemática. En algunos casos, se toman suposiciones adicionales para correlacionarse entre sí, como los parámetros que caracterizan la distribución de una variable aleatoria en diferentes muestras. En la prueba del estudiante, que a menudo se usa para comparar la media (expectativa) de dos series de datos con su homogeneidad o heterogeneidad, una suposición adicional sobre la homogeneidad de la dispersión de la distribución de variables aleatorias en las dos poblaciones generales de las cuales estos datos Los extractos se convirtieron.

La ventaja de los métodos de análisis de datos paramétricos es el hecho de que tiene una potencia bastante alta. Bajo el rendimiento de la prueba, piense en su capacidad para evitar errores del segundo tipo o error β. Cuanto más pequeño sea el error β, mayor será la separación de la prueba. En otras palabras, el rendimiento de la prueba = 1 – β.

El alto significado de las pruebas o criterios paramétricos se debe al hecho de que estos métodos requieren una descripción de la escala métrica de datos disponible.

Como es bien sabido, las escalas métricas incluyen la escala de intervalo y la escala de relación, que a veces también se conoce como una escala absoluta. La escala de intervalo permite al investigador no solo descubrir las relaciones entre la igualdad o la desigualdad de los elementos de la muestra (como posible es la escala de nombre) y no solo organizar relaciones (como sea posible, escala de orden), sino también evaluar la equivalencia de intervalos. La escala absoluta también le permite evaluar la equivalencia de las relaciones entre los elementos de la multitud que se obtuvieron durante la medición. Es por eso que las escalas métricas también se conocen como escalas de medición fuertes. Debido a este rendimiento, los métodos paramétricos permiten una expresión más detallada de las diferencias en la distribución de una variable aleatoria, sujeto a la verdad de la lista o hipótesis alternativas.

También se debe tener en cuenta que los métodos paramétricos de estadísticas en general se desarrollan aún más en la teoría de las estadísticas matemáticas y, por lo tanto, se utilizan mucho más. Casi todos los resultados experimentales se pueden evaluar con cada uno de estos métodos. Estos son estos métodos que se tienen principalmente en libros de texto y manuales para el análisis de datos estadísticos.

¿Qué características se deben cumplir para aplicar una prueba no paramétrica?

Recuerde que utiliza estadísticas para hacer inferencias sobre poblaciones de muestras. La mayoría de las técnicas que utilizan los estadísticos requieren que se cumplan dos suposiciones. Primero, la población de la que proviene la muestra es normal. En segundo lugar, cada vez que se calculan los medios y las variaciones, los números en los datos son cardinales o intervalo, lo que significa que el valor dado una observación no solo le indica qué observación es más grande o menor, sino cuánto más grande o más pequeño. Hay muchas situaciones en las que no se cumplen estos supuestos, y el uso de las técnicas desarrolladas hasta ahora no serán apropiadas. Afortunadamente, los estadísticos han desarrollado otro conjunto de técnicas estadísticas, estadísticas no paramétricas, para estas situaciones. Tres de estas pruebas se explicarán en este capítulo. Estos tres son la prueba U de Mann-Whitney, que prueba para ver si dos muestras elegidas independientemente provienen de poblaciones con la misma ubicación; la prueba de suma de rango de Wilcoxon, que prueba para ver si dos muestras emparejadas provienen de poblaciones con la misma ubicación; y la correlación de rango de Spearman, que prueba para ver si se relacionan dos variables. La prueba U de Mann-Whitney también se presenta en una plantilla de Excel interactiva.

Para un estadístico, un parámetro es una característica medible de una población. Las características de la población que generalmente interesan a los estadísticos son la ubicación y la forma. Las estadísticas no paramétricas se utilizan cuando los parámetros de la población no son medibles o no cumplen con ciertos estándares. En los casos en que los datos solo ordenan las observaciones, de modo que se desconoce el intervalo entre las observaciones, ni una media ni una varianza se pueden calcular de manera significativa. En tales casos, debe usar pruebas no paramétricas. Debido a que su muestra no tiene datos cardinales o intervalos, no puede usarla para estimar la media o la varianza de la población, aunque puede hacer otras inferencias. Incluso si sus datos son cardinales, la población debe ser normal antes de que se conozcan la forma de las muchas distribuciones de muestreo. Afortunadamente, incluso si la población no es normal, tales distribuciones de muestreo generalmente están cerca de la forma conocida si se usan muestras grandes. En ese caso, el uso de las técnicas habituales es aceptable. Sin embargo, si las muestras son pequeñas y la población no es normal, debe usar estadísticas no paramétricas. Como saben, «no existe un almuerzo gratis». Si desea hacer una inferencia sobre una población sin tener datos cardinales, o sin saber que la población es normal o con muestras muy pequeñas, tendrá que renunciar a algo. En general, las estadísticas no paramétricas son menos precisas que las estadísticas paramétricas. Debido a que sabes menos sobre la población que estás tratando de aprender, las inferencias que haces son menos exactas.

Cuando (1) la población no es normal y las muestras son pequeñas, o (2) cuando los datos no son cardinales, se utilizan las mismas estadísticas no paramétricas. La mayoría de estas pruebas implican clasificar a los miembros de la muestra, y la mayoría implica comparar la clasificación de dos o más muestras. Debido a que no podemos calcular estadísticas de muestra significativas para comparar con un estándar hipotético, terminamos comparando dos muestras.

En el Capítulo 5, «La prueba t», aprendió a probar para ver si dos muestras provienen de poblaciones con la misma media mediante el uso de la prueba t. Si sus muestras son pequeñas y no está seguro de si las poblaciones originales son normales, o si sus datos no miden intervalos, no puede usar esa prueba t porque las puntuaciones T de la muestra no seguirán la distribución de muestreo en la tabla T . Aunque hay dos problemas de datos diferentes que le impiden usar la prueba t, la solución a ambos problemas es la misma, la prueba U de Mann-Whitney no paramétrica. La idea básica detrás de la prueba es juntar las muestras, clasificar a los miembros de la muestra combinada y luego ver si las dos muestras se mezclan en el ranking común.

¿Qué factores determinan la aplicación de una prueba paramétrica y no paramétrica?

Una disputa trincheras y apasionada sobre el uso de métodos paramétricos versus no paramétricos para el análisis de datos ordinales de la escala Likert ha continuado durante las últimas ocho décadas. La respuesta no es un simple «sí» o «no», sino que está relacionado con hipótesis, objetivos, riesgos y paradigmas. En este artículo, adoptamos un enfoque pragmático. Aplicamos ambos tipos de métodos al análisis de datos Likert reales sobre respuestas de diferentes subgrupos profesionales de farmacéuticos europeos con respecto a las competencias para la práctica. Los resultados obtenidos muestran que con los números «grandes» (> 15) de respuestas y distribuciones similares (pero claramente no normales) de diferentes subgrupos, los análisis paramétricos y no paramétricos dan en casi todos los mismos resultados significativos o no significativos para Comparaciones de subgrupos. Los métodos paramétricos fueron más discriminantes en los casos de conclusiones no similares. Teniendo en cuenta que las mayores diferencias en las opiniones ocurrieron en la parte superior de la escala Likert de 4 puntos (clasifica 3 «muy importantes» y 4 «esenciales»), se realizó un «análisis de puntaje» basado en esta parte de los datos. Esta transformación de los datos de Likert ordinales en puntajes binarios produjo una representación gráfica que era visualmente más fácil de entender ya que las diferencias se acentúan. En conclusión, en este caso de datos ordinales de Likert con altas tasas de respuesta, restringir el análisis a los métodos no paramétricos conduce a una pérdida de información. La adición de métodos paramétricos, análisis gráfico, análisis de subconjuntos y transformación de datos conduce a análisis más profundos.

Los métodos estadísticos tienen lo siguiente como funciones principales: (1) el diseño de hipótesis y de procedimientos experimentales y la recopilación de datos; (2) la presentación sintética de datos para una comprensión fácil, clara y significativa; y (3) el análisis de datos cuantitativos para proporcionar conclusiones válidas sobre los fenómenos observados. Para estas tres funciones principales, generalmente se aplican dos tipos de métodos: paramétricos y no paramétricos. Los métodos paramétricos se basan en una distribución normal o gaussiana, caracterizadas por la media y la desviación estándar. La distribución de resultados es simétrica alrededor de la media, con el 95% de los resultados dentro de dos desviaciones estándar de la media. Las estadísticas no paramétricas no se basan en tales distribuciones de probabilidad parametrizadas o de hecho en cualquier suposición sobre la distribución de probabilidad de los datos. Las estadísticas paramétricas se utilizan con datos continuos de intervalo que muestran la igualdad de intervalos o diferencias. Los métodos no paramétricos se aplican a los datos ordinales, como los datos de la escala Likert [1] que implican la determinación de «más grande» o «más pequeño», es decir, la clasificación de datos [2].

La discusión sobre si las estadísticas paramétricas se pueden usar de manera válida y robusta para la presentación y análisis de datos no paramétricos han estado ocurriendo durante décadas [3,4,5,6]. Las simulaciones teóricas que utilizan datos generados por computadora han sugerido que los efectos de la no normalidad de las distribuciones, variaciones desiguales, tamaño de muestra desigual, etc. sobre la robustez de los métodos paramétricos no son determinantes [7], excepto en casos de distribuciones muy inusuales con un bajo número de datos.

Con respecto a los datos ordinales de Likert, la discusión teórica del análisis «paramétrico versus no paramétrico» continúa [8,9]. En este documento, investigaremos esto desde un ángulo práctico utilizando datos de Likert real obtenidos en un estudio reciente sobre la clasificación de competencias de los profesionales de la farmacia requerida para la práctica de farmacia [10]. Las diferencias y similitudes entre los diferentes subgrupos de farmacéuticos se discuten en detalle en el último documento. En este artículo, hacemos una pregunta específica sobre la metodología estadística: ¿la importancia de las diferencias dentro y entre los subgrupos de profesionales en la clasificación de la importancia de las competencias para la práctica diverge con el tipo de análisis (paramétrico o no paramétrico) utilizado? Utilizaremos los datos para farmacéuticos de la comunidad y su comparación con los de los farmacéuticos industriales como ejemplo.

La historia detrás de la elección del conjunto de datos para este artículo es la siguiente. El proyecto PHAR-QA tenía como punto final principal la estimación de las competencias centrales para los estudiantes de posgrado de farmacia que en general son aceptados por todos los subgrupos, cualquiera que sea el método estadístico utilizado; Esto se presenta en la sección de resultados. El punto final secundario consistió en las diferencias entre los subgrupos profesionales y encontramos diferencias claras entre los grupos, sea cual sea el método estadístico utilizado. Como se sugiere por la importancia del término de interacción, estas diferencias entre los subgrupos se centran en gran medida en competencias particulares (ver resultados). Este documento sigue a los que ya publican en esta encuesta PHAR-QA, y su propósito principal es comparar el uso y las conclusiones de los análisis paramétricos y no paramétricos.

Artículos Relacionados: