- Los métodos no paramétricos son fácilmente comprensibles, muy simples y fáciles de aplicar, y no requieren una teoría de muestras complicada.

- No se asume sobre la forma de la función de frecuencia de la población principal desde la cual se realiza el muestreo.

- Ninguna técnica paramétrica se aplicará a los datos que se miden a escala nominal, mientras que existen métodos no paramétricos para tratar dichos datos.

- Dado que la mayoría de los datos socioeconómicos no se distribuyen normalmente, las pruebas no paramétricas han encontrado aplicaciones en psicometría, sociología y educación.

- Las pruebas no paramétricas están disponibles para tratar los datos que se dan en rangos o cuyas puntuaciones aparentemente numéricas tienen la fuerza de los rangos. Por ejemplo, no se puede aplicar una prueba paramétrica si los puntajes se dan en las calificaciones.

- Los supuestos detrás de estos son menos y mucho más débiles que los asociados con las pruebas paramétricas.

- Las pruebas no paramétricas solo se pueden usar si las mediciones son nominales u ordinales. Incluso en ese caso, si existe una prueba paramétrica, es más poderosa que la prueba no paramétrica. En otras palabras, si todos los supuestos de un modelo estadístico son satisfechos con los datos y si las mediciones son de resistencia requerida, las pruebas no paramétricas son derrochadores de tiempo y datos.

- Hasta ahora, no existen pruebas no paramétricas para probar interacciones en el modelo ANOVA a menos que se realicen suposiciones especiales sobre la aditividad del modelo.

- Las pruebas no paramétricas están diseñadas para probar solo hipótesis estadística y no para estimar los parámetros.

Actualmente estoy cursando un Ph.D. en matemáticas. Antes de esto, completé mi maestría en matemáticas y solteros en estadísticas.

Creé este sitio web para explicar los conceptos de matemáticas y estadísticas de la manera más simple posible.

¿Cuál es la importancia de la utilidad de pruebas no paramétricas en estadística inferencial?

La prueba de chi-cuadrado (χ2) se relaciona con estadísticas no paramétricas, es típicamente fácil de calcular y es capaz de procesar datos medidos en una escala nominal (variables categóricas). χ2 es una prueba estadística utilizada con frecuencia para comparar los datos observados con los datos que se espera que se obtengan de acuerdo con una hipótesis específica. Si se toma una muestra de tamaño N de una población que tiene una distribución normal con μ media y desviación estándar α, puede permitir que se realice una prueba de si la varianza de la población tiene un valor predeterminado. Cada observación se puede estandarizar a la forma normal estándar con la media de 0 y la varianza unitaria después de Zi = (xi – x¯)/s) para muestras o z = (xi – μ)/α para parámetros de población. Los valores de Z se cuadran para eliminar el signo y se suman para formar una nueva estadística: ∑z2 = ∑i = 1n {(xi – μ)/α} 2.

El procesamiento de datos, la interpretación y las pruebas de la hipótesis son similares a las pruebas T y F paramétricas. La prueba de chi-cuadrado calcula un valor de los datos utilizando el procedimiento χ2. El valor se compara con un valor crítico de una tabla χ2 con un grado de libertad equivalente al de los datos (Cuadro 9.2). Si el valor calculado es mayor o igual al valor de la tabla, se rechaza la hipótesis nula. Si el valor es menor que el valor crítico, se acepta la hipótesis nula. χ2 es una prueba importante en estadísticas no paramétricas. Se utiliza para probar la diferencia entre una muestra real y otra población hipotética o previamente establecida, lo que se espera debido al azar o la probabilidad:

Valores críticos de χ2 para varios grados de libertad y niveles seleccionados de importancia de la Tabla 24, Penguin-Honeywell Book of Tablas (Kellaway, 1968).

donde oi = frecuencia observada de la clase ésima y ei = frecuencia esperada de la clase ésima.

¿Por qué son importantes las pruebas no paramétricas?

Los parámetros son características de la población que se está estudiando, como una media (|), desviación estándar (a) o mediana (MD). Las estadísticas describen las características de una muestra. Media de muestra (x) y mediana de muestra (M) son dos ejemplos. En estadísticas paramétricas tradicionales o clásicas, hacer inferencias de una muestra o muestras a una población o poblaciones requiere suposiciones sobre la naturaleza de la distribución de la población, como una distribución normal de la población.

Las estadísticas no paramétricas pueden definirse como métodos estadísticos que contribuyen con procedimientos de prueba y estimación válidos bajo supuestos menos estrictos que las estadísticas paramétricas clásicas. Sin embargo, no existe un acuerdo general en la literatura con respecto a la especificación exacta del término «estadísticas no paramétricas». En el pasado, las estadísticas no paramétricas y el término «métodos libres de distribución» se usaban comúnmente indistintamente en la literatura, aunque tienen diferentes implicaciones. Las estadísticas no paramétricas a menudo se denominan estadísticas libres de distribución porque no se basan en un tipo particular de una distribución en la población, como una distribución normal. Sin embargo, se acuerda generalmente que las estadísticas no paramétricas requieren menos supuestos o menos estrictos sobre la naturaleza de la distribución de la población que se está estudiando, en comparación con las estadísticas paramétricas clásicas. Es importante tener en cuenta que las estadísticas no paramétricas tampoco son totalmente libres de suposiciones, ya que deben basarse en algunas suposiciones aplicables a pruebas específicas, como la falta de lazos o la independencia de dos muestras aleatorias incluidas en el estudio. Son flexibles en su uso y generalmente son bastante robustos. Las estadísticas no paramétricas permiten a los investigadores llegar a conclusiones basadas en valores de probabilidad exactos y el intervalo de confianza.

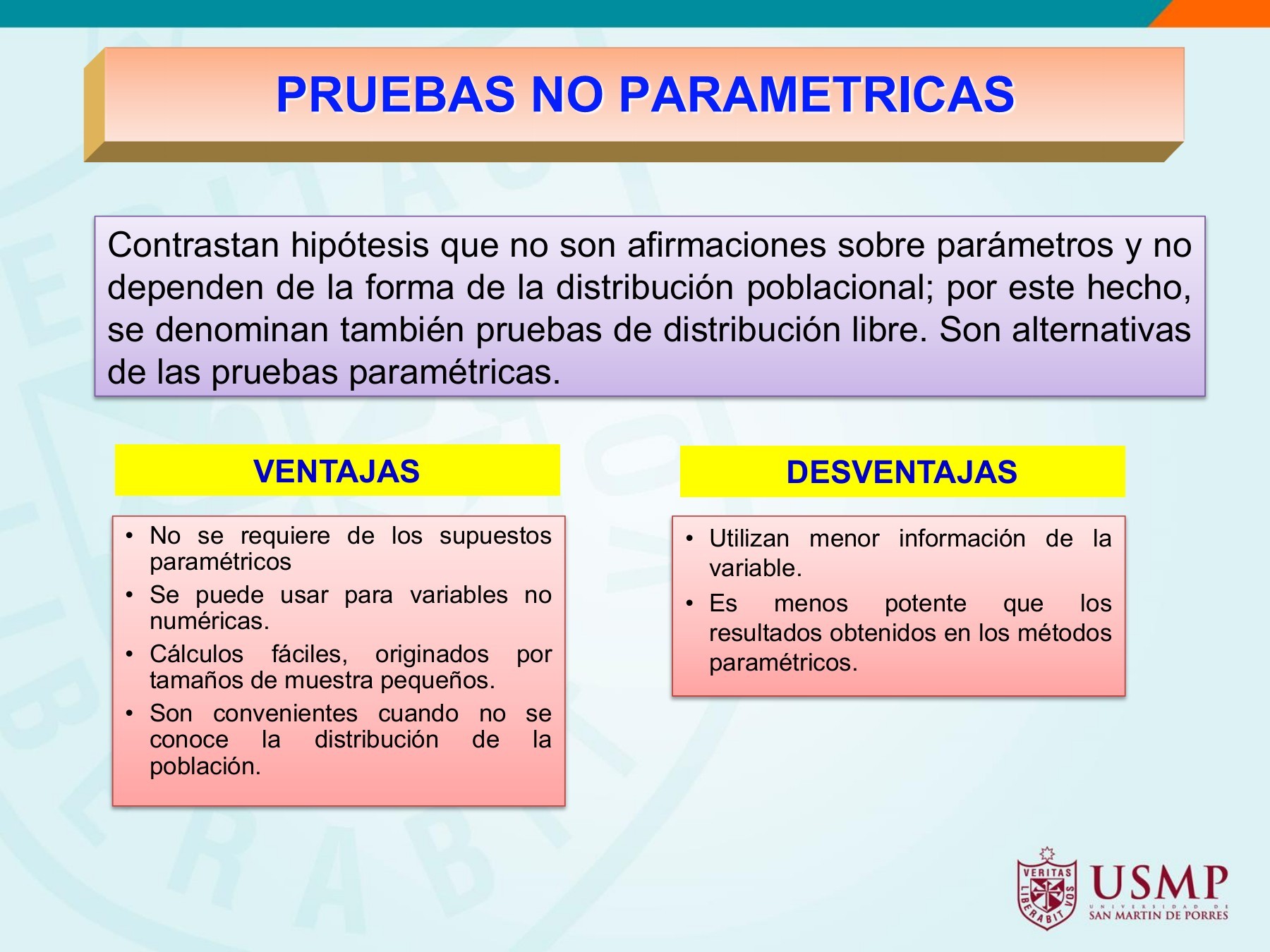

Las principales ventajas de las estadísticas no paramétricas en comparación con las estadísticas paramétricas son que: (1) pueden aplicarse a una gran cantidad de situaciones; (2) se pueden entender más fácilmente intuitivamente; (3) se pueden usar con tamaños de muestra más pequeños; (4) Se pueden usar con más tipos de datos; (5) necesitan menos suposiciones o menos estrictas sobre la naturaleza de la distribución de la población; (6) generalmente son más robustos y no a menudo no afectan seriamente por valores extremos en datos como valores atípicos; (7) tienen, en muchos casos, un alto nivel de eficiencia relativa asintótica en comparación con las pruebas paramétricas clásicas; (8) La introducción de Jackknife, Bootstrap y otras técnicas de remuestreo ha aumentado su rango de aplicabilidad; y (9) proporcionan una serie de pruebas y técnicas suplementarias o alternativas a las pruebas paramétricas actualmente existentes.

¿Que son y cuando se utilizan las pruebas no paramétricas?

Las pruebas no paramétricas son aquellas pruebas de hipótesis utilizadas en el campo de las estadísticas no paramétricas, el área en la que las estadísticas están libres de distribución o se basan en distribuciones cuyos parámetros no se especifican.

La prueba Wilcoxon y la prueba de Mann-Whitney (también conocida como Mann-Whitney Test U) son dos de las pruebas no paramétricas más poderosas para verificar, en presencia de valores ordinales de una distribución continua, si vienen dos campeones estadísticos de la misma población.

Las pruebas paramétricas son aquellas pruebas estadísticas que utilizan un modelos de distribución de población preestablecidos (no libres de distribución). Se llaman paramétricos en cuanto a ellos, las hipótesis se hacen en los parámetros ¿Cómo? o? 2 de una población (generalmente normal) de la que se extrae la muestra.

La prueba del cuadrado de Pearson (o de la bondad de la adaptación) es una prueba no paramétrica aplicada a grandes muestras cuando en presencia de variables nominales y desea verificar si la muestra se extrajo de una población con una distribución predeterminada o que dos o más muestras derivan de…

Si el valor p>? La evidencia empírica no es suficientemente contraria a la hipótesis nada que, por lo tanto, no se puede rechazar; Si el valor p? ? La evidencia empírica es fuertemente contraria a la hipótesis nada que, por lo tanto, debe ser rechazada. En este caso se dice que los datos observados son estadísticamente significativos.

¿Cuándo utilizamos las pruebas no paramétricas?

Las pruebas no funcionales evalúan las propiedades de la aplicación que no son críticas para la funcionalidad pero que contribuyen a la experiencia del usuario final. El rendimiento y la confiabilidad bajo carga no son componentes funcionales de un sistema de software, pero ciertamente pueden hacer o romper la experiencia del usuario. Algo que falla una prueba no funcional no siempre causa un problema que los usuarios notarían, pero puede indicar un problema en el sistema, especialmente a escala.

- Pruebas de rendimiento

- Prueba de carga

- Prueba de usabilidad

- Prueba de seguridad

Un proceso esencial en la categoría de pruebas no funcionales se centra en el rendimiento. Las pruebas de rendimiento aseguran que un sistema de software responda a las solicitudes de inmediato. La mala latencia destruye la experiencia de un usuario, y las pruebas de rendimiento bien escritas a menudo atrapan problemas antes de que sean evidentes para los usuarios.

La prueba de carga es un tipo relacionado de pruebas no funcionales. Pocos sistemas realizan lo mismo en responder a una solicitud por segundo que lo hacen a 10,000 solicitudes por segundo. La prueba de carga valida que un sistema puede manejar las cargas máximas y fallar con gracia cuando carece de los recursos para manejar los picos de carga de trabajo.

La prueba de usabilidad mide la calidad de la experiencia de un usuario. En su mayor parte, las pruebas de usabilidad son un proceso manual que no escala bien. De todos modos, la falta de pruebas de usabilidad, especialmente al localizar las aplicaciones, a menudo conduce a interfaces confusas e no intuitivas. Vale la pena pasar algún tiempo incorporando este tipo de prueba en el proceso de desarrollo de su software.

¿Cuándo se utiliza una prueba paramétrica?

Cuando nos adherimos a la hipótesis de la distribución normal durante la fase de verificación de hipótesis estadísticas, realizamos nuestros análisis a través de pruebas paramétricas. En resumen, utilizaremos pruebas paramétricas cuando nuestras mediciones numéricas estén de acuerdo con una distribución normal.

Algunas hipótesis se realizan en la aplicación de pruebas paramétricas (como la normalidad de la población, la selección aleatoria de las muestras). Estas hipótesis generalmente no se verifican y se supone que lo son. La validez del resultado logrado por las pruebas depende de la validez de las hipótesis.

La prueba no paramétrica se puede definir como una prueba de hipótesis.

La prueba no paramétrica se define como una verificación de hipótesis que no se basa en contrataciones básicas, es decir, la distribución de la población con ciertos parámetros. No necesita ser visto. La prueba se basa principalmente en las diferencias en los medios. Por lo tanto, se conoce alternativamente como la prueba de no distribución.

Una prueba estadística en la que se realizan ciertas hipótesis en un parámetro de la población se conoce como prueba paramétrica. Una prueba estadística utilizada para variables no métricas independientes se llama prueba no paramétrica. En las pruebas paramétricas, las estadísticas de prueba se basan en la distribución.

La aplicabilidad de la prueba paramétrica es solo para variables.

La aplicabilidad de la prueba paramétrica es solo para variables, mientras que la prueba no paramétrica se aplica tanto a las variables como a los atributos. Para medir el grado de relación entre dos variables cuantitativas, la correlación de la correlación de Pearson se usa en la prueba paramétrica y en la prueba no paramétrica la correlación del rango de Spearman.

Artículos Relacionados: